🤖

💻

🧠

⚡

🦀

Working

Collaborating

Playing

Creating

Thinking

Working

只是我自己的实践,no best practice

AI 进化速度太快,所有经验都只是暂时的

一切需要自己和 AI 磨合探索

一切需要自己和 AI 磨合探索

← → 翻页 · ↑ ↓ 步进 · ESC 总览 | 这个 slides 也是 AI 做的

从 ⇥ 到 Agent

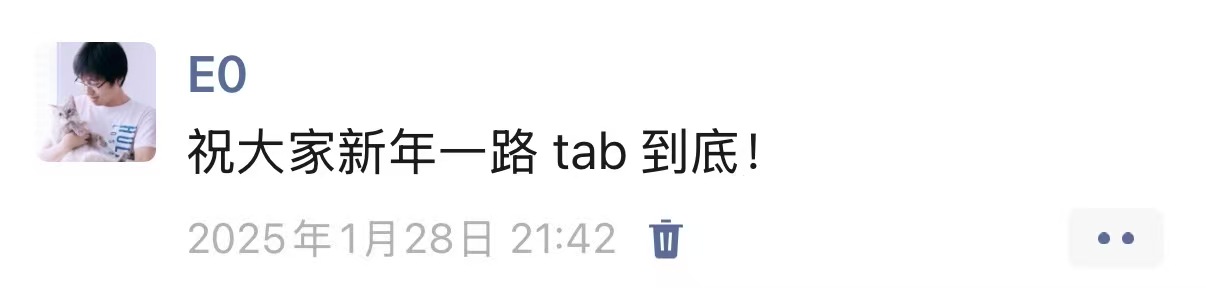

2025.01.28

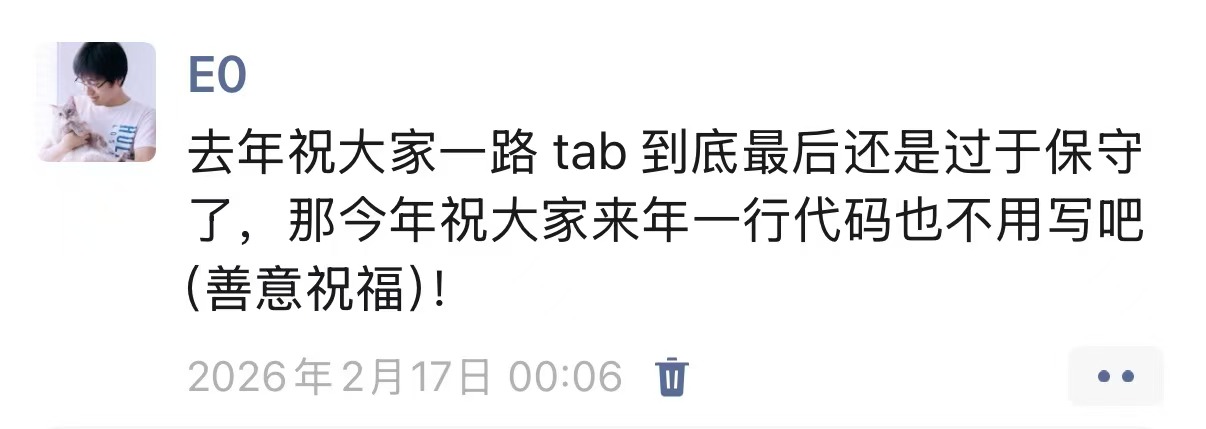

2026.02.17

⇥ Tab

行内自动补全

→

⇥⇥ Tab Tab

多插入点同时补全

→

🤖 Agent

你说目的地,AI 开车

AI 编程的自动驾驶等级

L0

完全人工

古法编程,非遗传承

L1

行内自动补全

L2

代码片段生成 · IDE chat

Byebye IDE 👋

L3

Coding agent,人 review

L4

Agent + AI review 完成项目

Byebye Human 😅

L5

AI 工程团队,完全自主

L3 开始瓶颈变成 code review

信任还需要慢慢建立才能往 L4 发展

信任还需要慢慢建立才能往 L4 发展

knowledge.jpeg

LLM 是对人类知识的一种有损压缩

模型越小,丢失越多 — 你看到的「幻觉」其实是压缩损失

模型越小,丢失越多 — 你看到的「幻觉」其实是压缩损失

RAW人脑 / 全部知识

PNGWikipedia · 教科书 · 文档

JPEGLLM — 实用,但有损失

拖动 → 模拟不同模型的「压缩率」

Quality: 50% — 🧠 Claude-class

幻觉不是 bug — 是压缩率的代价

模型越大,精度越高

模型越大,精度越高

我的 工具选择

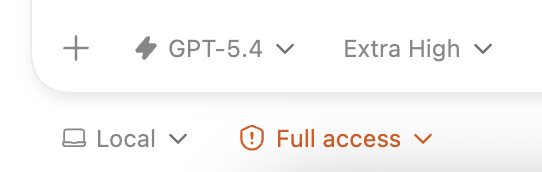

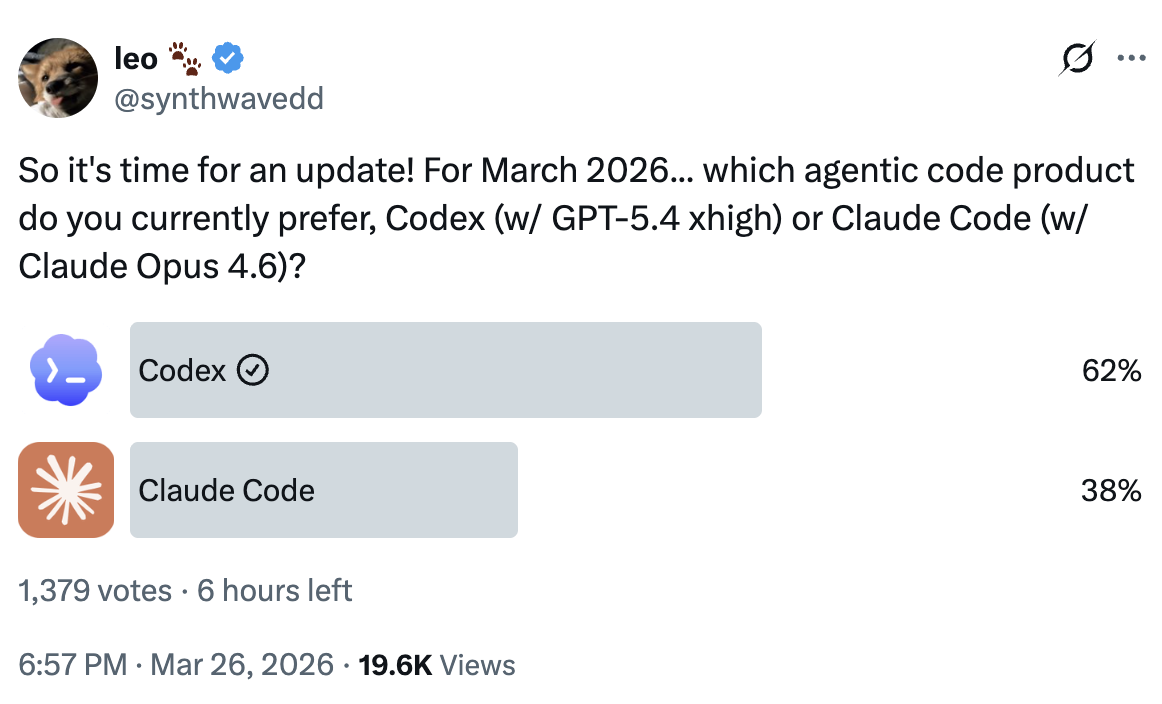

Codex

写代码唯一选择

Claude Code

创意工作

ChatGPT

Research

Playwright

MCP

有人说 Codex 太慢了

靠谱才是真的快

靠谱才是真的快

关于 Skills

⚫⚪

棋谱

人总结的「最佳实践」

→

🧠

AlphaZero

自己发现更好的走法

模型进化太快 — 今天的「棋谱」在下一代面前可能是次优解

LLM 也会有自己的 AlphaZero 时刻,而且并不遥远

LLM 也会有自己的 AlphaZero 时刻,而且并不遥远

什么时候 Skill 有用?

让 AI 快速掌握特殊工具 · 自己不熟悉、不容易判断好坏的领域

即使没有 skill,agent 也能从文档学习 — skill 只是提炼出的索引

让 AI 快速掌握特殊工具 · 自己不熟悉、不容易判断好坏的领域

即使没有 skill,agent 也能从文档学习 — skill 只是提炼出的索引

什么时候 Skill 不太有用?

模型已经很熟的领域(主流语言 / 框架)· skill 可能限制 AI 的灵活性

模型更新后 skill 可能变成瓶颈 — 它按旧经验走,而模型已经「会了」

模型已经很熟的领域(主流语言 / 框架)· skill 可能限制 AI 的灵活性

模型更新后 skill 可能变成瓶颈 — 它按旧经验走,而模型已经「会了」

推荐探索:skills npm package ↗ · skills.sh ↗

CLI vs. MCP

CLI

👤 人 / Agent

→

💻 Shell

→

🔧 工具

快

可组合

透明可调试

开发内环 · Agent 通过 shell 直接调用

+

MCP

🤖 模型

→

📡 协议

→

🔧 工具

可发现

跨客户端

结构化输入输出

集成外环 · 标准化工具发现与权限管理

对 Agent 来说两者都很有用 — 多数团队最终二者并存

CLI 做底层实现 + 专家入口,MCP 做标准化接口层

CLI 做底层实现 + 专家入口,MCP 做标准化接口层

推荐:

GitHub 官方 CLI — Agent 友好、半结构化输出、可组合

详细分析 ↗

gh CLIGitHub 官方 CLI — Agent 友好、半结构化输出、可组合

Workflow

🔍 Research

→

📐 Plan

→

⚡ Implement

⇄

👀 Review

loop

Agent 的内循环(每次执行)

Plan → Edit → Run tests → Observe → Repair → Update

— OpenAI Codex 文档里描述的 inner loop

我们的 workflow 是更大的外循环 — 跨 turn、可持久化、跨 session

Plan → Edit → Run tests → Observe → Repair → Update

— OpenAI Codex 文档里描述的 inner loop

我们的 workflow 是更大的外循环 — 跨 turn、可持久化、跨 session

journey/ 目录结构 — 把过程写进文件,跨 session 不丢 track

journey/

├── research/

├── plans/

├── prompts/

├── logs/

└── ...

每个阶段是一个目录,输出 = 对开发过程和决策的 distill

Research 双模式

Context-free

不带先入为主的 bias

基于第一性原理调研

基于第一性原理调研

ChatGPT Deep Research

+

Context-rich

理解当前设计决策和限制

在现有架构内寻找最佳方案

在现有架构内寻找最佳方案

Claude Code · Codex

先不带预设地调研,再结合项目上下文落地

两者结合 → 补完思考空间 → 更好的设计决策

两者结合 → 补完思考空间 → 更好的设计决策

一些个人 Prompt 经验

01

基于第一性原理思考

不要套用模式,从根本推导

不要套用模式,从根本推导

02

从根源解决,避免 ad-hoc patch

找到问题的本质,不是糊一层

找到问题的本质,不是糊一层

03

对我的思路保持中立

不要假设我之前的做法是正确的,该挑战就挑战

不要假设我之前的做法是正确的,该挑战就挑战

04

先理解现有代码再动手

不要还没读完就开始改,先搞清楚为什么这样写

不要还没读完就开始改,先搞清楚为什么这样写

05

相信 AI 的基础能力

不限定文件路径,不给固定 context — 让 AI 自己去找、去判断

不限定文件路径,不给固定 context — 让 AI 自己去找、去判断

多使用,对 AI 能干什么不能干什么有完整的感受

对于 AI 擅长的 → 相信 AI

对于 AI 擅长的 → 相信 AI

不只是

Vibe Coding

Vibe Coding

AI 不只能写代码 — 它能帮你沟通、协作、探索想法

不只是 Vibe Coding

设计交互协作

我们开发的是给 developer 用的工具

有些场景开发者比设计师更理解需求

有些场景开发者比设计师更理解需求

开发者用 AI 快速出原型 → 和设计师一起看效果 → 迭代

交互细节不再靠文字描述和想象

交互细节不再靠文字描述和想象

v0-kong-datakit-flow-editor.vercel.app

点击预览 ↗

不只是 Vibe Coding

会议讨论准备

Deep Research 调研 → 结合自己的 key observation 和 insight 整理成文档

→ 丢给 Claude Code 制作可交互的讨论材料

→ 丢给 Claude Code 制作可交互的讨论材料

例:围绕"能不能用 vibe coded 的原型作为设计交付物"这个话题

要求 AI 尽量使用直观的可视化方法来呈现

要求 AI 尽量使用直观的可视化方法来呈现

vibe-hand-off.vercel.app

点击预览 ↗

不只是 Vibe Coding

辅助沟通理解

复杂的技术方案,用文字描述容易有理解偏差

做个可交互的文档出来,比说一百句都清楚

做个可交互的文档出来,比说一百句都清楚

用 AI 快速生成可交互的文档

团队成员直接看、直接操作,减少反复确认

团队成员直接看、直接操作,减少反复确认

v0-plugin-form-optimization.vercel.app

点击预览 ↗

用 AI 做设计

AI 味的本质 = 平均设计:什么都有,但缺少取舍和个性

用 Skill 能去除 AI 味 — 但基于 Skill 做出来的版式

会不会成为新的 AI 味?

会不会成为新的 AI 味?

一些变化

深度使用 AI 之后,一些习惯和心态上的感受

信息获取方式在变

从构造 query 到直接表达需求

你脑中的问题

React 项目打包后首屏白屏,控制台没有报错

react 白屏 production 无报错

→ react blank page after build

→ react chunk load error white screen

多次换 query · 扫 StackOverflow · 自己筛选

vs

直接描述问题和上下文 → 一次给出诊断 + 方案

Web search 本质上自动完成了人肉搜索

单次搜索可能更快,但拿到答案的整体速度后者更快

我的 Google 使用量下降了 95%

剩下 5% 是肌肉记忆 — 忘了切换,在地址栏打了

我的 Google 使用量下降了 95%

剩下 5% 是肌肉记忆 — 忘了切换,在地址栏打了

默认不信任 「快」

用了 AI 以后,我反而开始信任「慢」

「快」给我一种不踏实的感觉 — AI 是不是跳过了什么?

「慢」说明它在认真思考,在做 research,在 plan

「慢」说明它在认真思考,在做 research,在 plan

这和我们对人的直觉一样:

三秒给你答案的人,你信吗?

三秒给你答案的人,你信吗?

AI 在生活中

Coding agent 就是通用 agent

Coding agent 本质上是一个用代码解决问题的方法论实现

最擅长写代码,但对数字世界的其他场景同样有广阔的用武之地

最擅长写代码,但对数字世界的其他场景同样有广阔的用武之地

📷 整理相册

Codex · 按日期/人物自动分类

📝 帮妻子 refresh 简历

Claude Code

⚽ 女儿足球赛赛历

Codex · 自动生成 .ics 订阅 ↗

📊 这个 Slides

Claude Code · 多轮 review

Q & A

或者继续聊 AI 的任何话题

这个 slides 是怎么做的?

策划 + 设计 + 实现 = 多轮对话 + 多次 review

github.com/Justineo/working-with-ai ↗